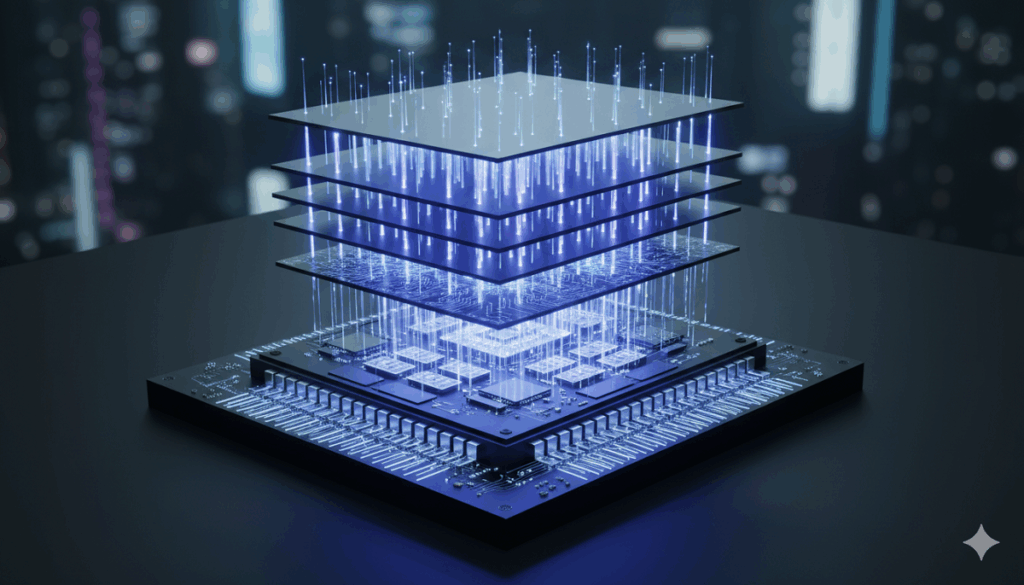

HBM4란 무엇인가

AI·고성능컴퓨팅(HPC) 시대의 핵심은 메모리 대역폭입니다.

HBM(High Bandwidth Memory)은 GPU와 AI 가속기, 데이터센터 서버에 탑재되는 초고속 스택형 메모리로, 병목현상을 해소하기 위한 최적의 솔루션으로 자리 잡았습니다.

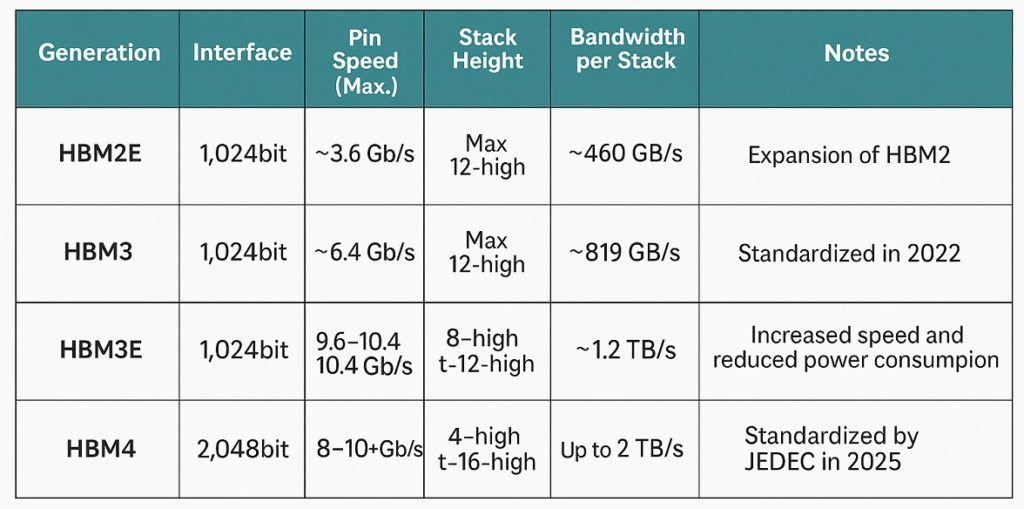

2025년 JEDEC이 공식 발표한 HBM4 표준은 기존 HBM3E를 뛰어넘는 대역폭과 효율을 제공합니다.

- 인터페이스 폭: 2,048bit (기존 대비 2배)

- 핀당 속도: 최대 8 Gb/s (벤더 확장 시 10 Gb/s 이상도 거론)

- 대역폭: 스택당 최대 약 2 TB/s

- 용량: 스택당 최대 ~64 GB (16-high 스택 기준)

- 주요 기술: TSV 기반 수직 스택 + 하이브리드 본딩 등 패키징 혁신

요컨대, HBM4는 메모리의 ‘CPU급 진화’라 불릴 만큼 성능과 공정이 동시에 도약한 세대입니다.

HBM 세대별 스펙 비교

HBM4의 본질은 ‘속도’보다 폭의 확장(2048-bit)입니다.

동일한 클럭에서도 대역폭이 2배 이상 확대되어, AI 가속기의 연산 병목을 크게 완화합니다.

주요 기업별 최신 동향

삼성전자, SK하이닉스, Micron

삼성전자

- 최근 언론 보도에 따르면 삼성전자는 1c DRAM(6세대 공정) 기반 HBM4 양산을 목표로 내부 설비를 확충 중입니다.

- 또한, 삼성은 HBM4E(차세대 HBM4 확장형) 개발도 동시에 진행 중이며, 3 TB/s 이상 대역폭을 목표로 하고 있습니다.

- 뉴스에 따르면 삼성은 AMD의 AI 가속기(MI450)용 HBM4 공급사로 거론되고 있습니다.

- 다만 현재 수율 이슈(1c DRAM 약 50% 수준)가 있다는 보도도 있어, 양산 전환 시점에 대한 시장의 관심이 집중되고 있습니다.

- 시사점: 삼성은 기술 사양 면에서 선도적 행보를 보이는 동시에, ‘양산 전환의 타이밍’이 경쟁사 대비 빠르게 풀릴 수 있는 변수로 분석됩니다.

SK하이닉스

- SK hynix는 2025년 9월 “HBM4 개발 완료 및 양산 준비”를 공식 발표했습니다.

- 보도에 따르면 핀당 속도 10 Gb/s 이상, 전력 효율약 +40% 개선된 사양을 확보했으며, 2026년 AI 가속기에 실사용될 전망입니다.

- 시사점: SK는 ‘첫 상용화’ 우위를 점하며 시장 점유율 방어 및 확대에 유리한 위치를 확보 중입니다.

Micron

- 최근 발표된 뉴스에 따르면 Micron은 샘플 출하 기준 2.8 TB/s 대역폭 및 핀당 11 Gb/s 이상을 달성했다고 합니다.

- Micron은 HBM4E 또한 고객 맞춤형 로직 다이(base die)와 패키징 혁신을 통해 수익성 개선을 꾀하고 있습니다.

- 시사점: Micron은 삼성·SK에 비해 다소 후발이지만, 성능 측면에서 경쟁력을 확보하며 틈새 시장을 노리고 있습니다.

시장 및 산업 시사점

AI와 함께 폭발하는 수요

생성형 AI 학습과 추론 트래픽이 급증하면서 메모리 대역폭이 시스템 성능의 실제 병목으로 부상하고 있습니다. GPU의 연산 성능은 세대별로 가파르게 향상되었지만, 외부 메모리에서 데이터를 전달받는 속도가 이를 충분히 따라가지 못했기 때문입니다

. HBM4는 2,048bit 인터페이스와 스택당 2 TB/s급 대역폭을 제공하여 이 간극을 실질적으로 축소합니다. 대규모 모델 학습에서 배치 크기·시퀀스 길이·활성화 체크포인트 등 메모리 집약적 변수들이 많아질수록 대역폭 여유는 장비 유휴 시간을 줄이고 활용률을 높입니다.

데이터센터 사업자 입장에서는 동일 전력·랙 공간 대비 처리량을 끌어올릴 수 있어, 차세대 GPU 플랫폼 도입 시 HBM4 채택 비중이 빠르게 확대될 가능성이 큽니다.

기술 장벽의 급상승

HBM4는 단순한 속도 향상을 넘어 패키징과 공정 전반의 난이도 상승을 전제로 합니다. 인터페이스 폭이 두 배로 확대되면서 기판·인터포저의 배선 밀도와 신호 무결성 관리가 더욱 까다로워지고, 스택 높이가 커질수록 TSV 저항·발열·수율의 균형점을 찾기가 어려워집니다. 이를 보완하고자 업계는 하이브리드 본딩, 로직 다이 최적화, 저전력 PHY 등 다층적 개선을 병행하고 있습니다.

그 결과 원가 구조는 복잡해지지만, 일단 기술 격차가 벌어지면 추격이 쉽지 않은 진입장벽 효과가 확대됩니다. 소재·장비·기판 등 소부장 밸류체인에서도 미세 가공, 고열전도 소재, 고주파 특성 강화 등 고사양 수요가 늘어나며 업스트림 전반의 기술 업그레이드를 촉발합니다.

가격 프리미엄 구조

업계에서는 HBM4가 초기에는 HBM3E 대비 60-70% 이상 가격 프리미엄을 가질 수 있다는 전망도 나옵니다. 이는 고성능 AI 가속기 수요가 먼저 반영되기 때문이며, 일반 메모리 시장과 달리 공급이 제한적인 구조이기 때문입니다.

투자 관점 포인트

관련 수혜기업

| 구분 | 포인트 | 관련 수혜 |

|---|---|---|

| 메모리 제조사 | HBM4 기술 선도 여부가 시장 점유율을 결정 | 삼성전자, SK hynix, Micron |

| 소부장 밸류체인 패키징·기판 | 인터포저·본딩·기판·테스트 장비 수요 증가 | (국내) 한미반도체, 원익IPS, 티씨케이, 하나머티리얼 등 |

| AI 인프라 | 데이터센터 GPU 확장과 함께 HBM4 수요 동반 증가 | 엔비디아, AMD, 인텔 등 |

| 중장기 변수 | 수율·원가·전력 관리 역량이 채택 속도와 점유율을 좌우 | 기술 성숙도에 따라 시장 재편 가능성 |

한미반도체(042700)

HBM4 생산 공정의 핵심 장비인 TC 본더(Thru-Chip Bonder) 공급사로, TSV 적층과 하이브리드 본딩 단계에 모두 관여합니다.

HBM3E에서 이미 공급 레퍼런스를 확보했으며, HBM4 본딩 채택률 확대에 따라 직접 수요 증가가 예상됩니다.

원익IPS(240810)

HBM4 패키징용 플라즈마 장비 및 증착·식각 공정 솔루션을 보유하고 있습니다.

HBM 공정의 열처리·식각 정밀도 요구가 상승하면서, 미세 공정 대응 장비 매출 증가가 기대됩니다.

티씨케이(064760) / 하나머티리얼즈(166090)

HBM TSV 공정에서 발생하는 고열·플라즈마 환경용 실리콘 파츠·세라믹 링을 공급합니다.

스택 수가 늘어나면서 소모성 부품 수요가 구조적으로 증가할 전망입니다.

요약 및 결론

HBM4는 단순한 ‘차세대 메모리’가 아니라 AI 시대의 메모리 인프라 혁신입니다.

인터페이스 폭 2배, 대역폭 2 TB/s, 용량 64 GB로의 도약은 GPU·AI 서버의 병목을 해소하고, 반도체 업계의 기술 격차를 더욱 벌려놓을 핵심 변수로 작용할 것입니다.

향후 관전 포인트

- 2025 하반기: HBM4 샘플 및 고객 검증 확대

- 2026 상반기: 본격 양산 및 차세대 GPU 탑재 기대

- 2027 이후: HBM4E/5로 이어지는 성능 및 수율 변곡점